Imagine assistir a um vídeo onde uma celebridade diz algo polêmico — mas que ela nunca falou. Ou ver seu próprio rosto inserido em uma cena de filme ou até em conteúdos impróprios sem o seu consentimento. Parece ficção científica? Pois essa é a realidade criada pela tecnologia deepfake.

O tema ganhou notoriedade nos últimos anos, tanto por usos criativos quanto pelas ameaças que representa. No Portal Novidade, vamos mostrar como funciona essa tecnologia, o que está por trás dos vídeos falsos hiper-realistas e o que o mundo está fazendo para tentar lidar com isso.

O que é um deepfake?

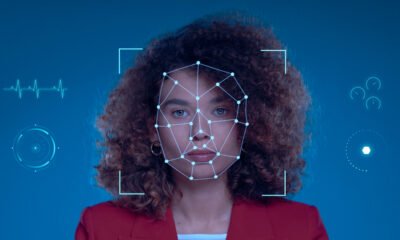

O termo deepfake vem da junção de “deep learning” (aprendizado profundo) com “fake” (falso). Trata-se de uma técnica de inteligência artificial que usa redes neurais para sobrepor rostos e vozes em imagens e áudios reais, criando vídeos falsificados que parecem absolutamente autênticos.

Na prática, é possível criar um vídeo onde qualquer pessoa pode ser feita para parecer dizer ou fazer qualquer coisa. Basta treinar o algoritmo com imagens e sons suficientes da pessoa em questão.

Como essa tecnologia evoluiu tão rápido?

A popularização dos deepfakes se deve a dois fatores principais: o avanço das IAs generativas e o aumento da capacidade de processamento dos computadores pessoais. Hoje, há aplicativos e sites acessíveis onde qualquer um pode criar um deepfake com poucos cliques.

O que antes era domínio de hackers e programadores avançados agora está ao alcance de influenciadores, humoristas — e, infelizmente, golpistas.

Os riscos dos deepfakes

A tecnologia deepfake representa um risco crescente para a sociedade. Entre os principais problemas:

Fake news: vídeos falsos usados para enganar eleitores, manipular narrativas ou desacreditar figuras públicas.

Fraudes financeiras: golpistas imitam rostos e vozes para aplicar golpes em empresas e familiares.

Assédio e pornografia falsa: rostos de pessoas reais são colocados em vídeos íntimos falsos, afetando principalmente mulheres.

Desinformação geral: em tempos de redes sociais, um vídeo convincente pode viralizar antes mesmo de ser checado.

Além disso, há um efeito colateral perigoso: quando tudo pode ser falsificado, as pessoas começam a duvidar até do que é real — fenômeno chamado de “negabilidade plausível”.

O que está sendo feito para combater?

Plataformas como YouTube, Instagram e TikTok estão implementando políticas mais rígidas e algoritmos de detecção de deepfakes.

Pesquisadores também desenvolvem tecnologias para identificar alterações digitais em vídeos, como análise de piscar de olhos, textura de pele e reflexos artificiais.

Governos em vários países discutem leis para criminalizar o uso malicioso dos deepfakes, especialmente em contextos eleitorais e de violência digital.

Mas, como toda tecnologia, o desafio é equilibrar liberdade criativa com responsabilidade social.

A tecnologia deepfake é uma das inovações mais fascinantes — e perigosas — da atualidade. Enquanto permite criações incríveis no cinema e na publicidade, também escancara vulnerabilidades éticas e legais.

Continue com o Portal Novidade e fique por dentro das transformações mais impressionantes — e controversas — do nosso tempo.

Recente

-

Tecnologia

/ 2 dias atrásO que é deepfake e como reconhecer

Nos últimos anos, a tecnologia evoluiu rapidamente, trazendo avanços impressionantes na criação de conteúdos...

Por Ana Victoria -

Tecnologia

/ 3 dias atrásComo evitar golpes no WhatsApp

O WhatsApp é um dos aplicativos de mensagens mais utilizados no mundo. Milhões de...

Por Ana Victoria -

Tecnologia

/ 3 dias atrásPor que anúncios te seguem na internet

Muitas pessoas já passaram pela mesma situação: pesquisar um produto na internet e, pouco...

Por Ana Victoria -

Tecnologia

/ 4 dias atrásO que são cookies e como eles funcionam

Ao acessar um site pela internet, muitas vezes aparece uma mensagem pedindo autorização para...

Por Ana Victoria -

Tecnologia

/ 4 dias atrásComo fazer backup do celular do jeito certo

O celular se tornou uma ferramenta essencial no dia a dia. Nele guardamos fotos,...

Por Ana Victoria